На современном этапе развития информационных технологий разработка методов автоматического определения эмоционального состояния человека по голосовым характеристикам является актуальной, так как автоматическое распознавание эмоций позволяет решить ряд экономических, социальных и бытовых проблем и, кроме того, играет важную роль в вопросах безопасности человека [3]. Эмоциональный речевой сканер может найти широкое применение в различных транспортных и диспетчерских учреждениях, для ограничения или полного запрета доступа к выполнению служебных обязанностей лиц, находящихся в неустойчивом или неадекватном эмоциональном состоянии. Подобные системы контроля позволят также проводить дополнительную проверку пассажиров авиарейсов в рамках мероприятий по противодействию терроризму [3].

О задаче определения численного значения эмоций человека

Решение задачи определения численного значения эмоций человека может применяться в проектировании эмоциональных роботов. Согласно заявлению доктора технических наук Сергея Манько: «Сначала потребуется научить электронную систему точно идентифицировать эмоциональное состояние человека, анализируя показания собственных датчиков и видеокамер. Затем научить робота принимать верные решения, то есть научить реагировать на них словом или делом» [2].

В дальнейшем в качестве датчика, который необходимо использовать при оценке эмоционального состояния человека по голосовым характеристикам, будем подразумевать микрофон.

Рассмотрим первую часть задачи проектирования эмоциональных роботов, которая состоит в определении численного значения эмоций по голосовым характеристикам

В настоящее время программных продуктов, которые измеряют эмоции по голосовым характеристикам практически не существует. На данный момент в основном это экспериментальные программы, которые распознают эмоции. Рассмотрим алгоритм под названием «Классификация эмоционально окрашенной речи с использованием метода опорных векторов» (И.Э. Хейдоров, Янь Цзинбинь, Уши, А.М. Сорока, А.А. Трус).

Авторы, рассматривая опорные вектора для распознавания эмоций, пришли к выводу о том, что применение метода опорных векторов для решения задач классификации эмоционально окрашенной речи позволяет получить высокую точность обученной модели. В сравнении с традиционными статистическими методами классификации [5] влияние методов извлечения векторов признаков на точность классификации обученной модели позволяет предположить, что модернизация этих методов является одним из путей дальнейшего увеличения точности рассмотренного в статье [5] классификатора.

В предлагаемой статье рассмотрены проблемы классификации эмоционально окрашенной речи, извлечения векторов признаков, предварительной обработки обучающих выборок, выбора параметров алгоритма и оценки свойств полученного классификатора на основе метода опорных векторов (МОВ).

Согласно исследованиям авторов алгоритма «Классификация эмоционально окрашенной речи с использованием метода опорных векторов» этот алгоритм позволяет достичь точности классификации при правильном выборе оптимальных параметров алгоритма и ядерной функции равной 96,2 %. Сложность выбора параметров является одним из минусов алгоритма, как в алгоритме отсутствует численное значение некоторой характеристики, которое ставится в соответствие значениям эмоции.

Опишем достоинства и недостатки алгоритма «Автоматическое определение изменений эмоционального состояния по речевому сигналу» (Лукьяница А.А., Шишкин А.Г.).

Авторы алгоритма описали технику отделения речи от пауз, а затем рассмотрели способы вычисления признаков, основанные на определении частоты основного тона, значениях трёх первых формант, а также на вычислении кепстра [1].

Исследования, проведённые авторами алгоритма, показали большую эффективность метода определения изменений в эмоциональном состоянии человека на основе анализа речевого сигнала. Достоинством алгоритма является высокая точность его работы (97.2 %) , к недостаткам алгоритма можно отнести сложность настройки алгоритма (так как алгоритм опирается на базы данных с примерами эмоциональных состояний и предполагает зависимость от языка абонента, у которого опознается эмоциональное состояние) и невозможность вычислить с помощью алгоритма численное значение амплитуды эмоции, то есть количественно измерить эмоцию.

Приведенные алгоритмы могут в той или иной степени решать задачу определения эмоций человека по голосовым характеристикам, но не возвращают численного значения эмоции человека.

Теперь рассмотрим один из вариантов решения второй части задачи проектирования эмоциональных роботов, которая заключается в моделирование ответной эмоциональной реакции робота, вызванной эмоциональным воздействием человека. Одним из таких вариантов является математическая теория эмоциональных роботов, разрабатываемая Пенским Олегом Геннадьевичем в ПГНИУ. Одно из возможных применений математическая теории эмоциональных роботов, заключается в приближение психологии мобильных устройств (в рамках данной статьи мы рассматриваем мобильное устройство как подвид робота) к психологии человека по способности забывать прошлое. Основными понятиями математической теории эмоциональных роботов являются сюжет, эмоция робота, элементарное воспитание робота, воспитание робота и коэффициент памяти.

В рамках статьи под эмоцией мобильного устройства будем понимать следующую функцию:

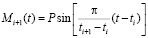

, (1)

, (1)

где  – эмоция мобильного устройства,

– эмоция мобильного устройства,  t – время действия эмоции во время такта

t – время действия эмоции во время такта  .

.

Под элементарным воспитанием мобильного устройства понимается функция:

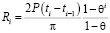

,

,

где  – элементарное воспитание мобильного устройства,

– элементарное воспитание мобильного устройства,  – эмоция мобильного устройства, i – порядковый номер воспитательного такта.

– эмоция мобильного устройства, i – порядковый номер воспитательного такта.

Под воспитанием мобильного робота принимается:

,

,

где  – воспитание эмоционального мобильного устройства за время ti; ti+1 – текущее время,

– воспитание эмоционального мобильного устройства за время ti; ti+1 – текущее время,  ,

,  коэффициент памяти, ti – общее время действия всех предыдущих эмоций.

коэффициент памяти, ti – общее время действия всех предыдущих эмоций.

Совершая преобразования, получим следующую формулу:

, (2)

, (2)

где  q – коэффициент памяти устройства, i – порядковый номер воспитательного такта.

q – коэффициент памяти устройства, i – порядковый номер воспитательного такта.

Более подробное описание вышеприведенных понятий можно прочитать в [5].

Для реализации использования возможностей математической теории эмоциональных роботов необходимо чтобы алгоритмы, распознающие эмоции человека, возвращали численное значение эмоций (то есть могли измерять эмоции), в то время как представленные выше алгоритмы («Классификация эмоционально окрашенной речи с использованием метода опорных векторов» и «Автоматическое определение изменений эмоционального состояния по речевому сигналу») лишь распознают их. Для этого рассмотрим авторский алгоритм, возвращающий численное значение эмоций.

Алгоритм измерения эмоций абонента мобильного телефона

Одним из источников эмоций, анализируемых алгоритмом, является речевой сигнал [4]. При изменении эмоционального состояния в человеческом организме происходят сложные процессы, которые в конечном итоге находят отражение в виде мышечных сокращений, в том числе и в голосовом тракте. Это даёт возможность бесконтактного определения эмоционального состояния человека по изменениям в системе речеобразования. Авторский алгоритм основывается на оценке амплитуды звуковой волны и на гипотезе, говорящей о том, что при изменении амплитуды звуковой волны, меняется эмоциональное состояние абонента.

Приведем шаги авторского алгоритма, определяющего численные характеристики эмоций мобильного устройства:

• Звуковая волна, поступающая в мобильное устройство через микрофон, разбивается на такты равные 1 секунде.

• На каждом такте вычисляется максимальное по модулю отклонение он начального значения амплитуды звуковой волны.

• Если отклонение отрицательное то эмоции приписывают отрицательное значение, иначе – положительное. Формула для определения численного значения амплитуды  эмоции на такте

эмоции на такте  описывается формулой

описывается формулой  , где

, где  – максимальное по модулю значение амплитуды звукового сигнала на такте

– максимальное по модулю значение амплитуды звукового сигнала на такте  , Ai – амплитуда звукового сигнала на такте

, Ai – амплитуда звукового сигнала на такте  .

.

Полученное значение  подставляется в формулы (1) и (2) вместо константы P и получаем следующие формулы:

подставляется в формулы (1) и (2) вместо константы P и получаем следующие формулы:

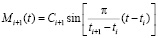

– определение эмоции мобильного устройства

, (3)

, (3)

где  – эмоция мобильного устройства для

– эмоция мобильного устройства для  воспитательного такта,

воспитательного такта,  – величина, отвечающая за эмоциональное состояние человека.

– величина, отвечающая за эмоциональное состояние человека.

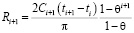

Определение воспитания мобильного устройства:

, (4)

, (4)

где q – коэффициент памяти устройства, i – порядковый номер воспитательного такта.

Формулы (3) и (4) дают возможность наблюдать взаимосвязь между эмоциональным состоянием человека и эмоциональным состоянием мобильного устройства. Другими достоинствами предлагаемого алгоритма являются также возможность определения численного значения эмоции устройства в зависимости от звуковых характеристик голоса абонента и независимость значения эмоций мобильного устройства от языка абонента.

Легко видеть, что асимптотическая сложность алгоритма равняется  , где n – количество тактов, на которые разбивается звуковая волна.

, где n – количество тактов, на которые разбивается звуковая волна.

Использование авторского алгоритма, основанного на математической теории эмоциональных роботов, позволяет придать некую эмоциональность мобильному устройству, настраивать и обучать мобильное устройство индивидуально для каждого абонента, в результате чего мобильное устройство начинает отражать некоторые психологические особенности своего владельца.

Заключение

В статье предложен алгоритм позволяющий находить численное значение эмоции, которую испытывает человек. Найденное значение с учетом математической теории эмоциональных роботов [2] предлагается использовать в определении эмоций абонента и моделировании эмоционального состояния мобильного устройства.

Недостатком описанного в статье алгоритма является то, что алгоритм измеряет численные значения эмоций, но не распознает их тип. К достоинствам представленного алгоритма можно отнести следующее: алгоритм является достаточно простым (настройка алгоритма происходит автоматически), результаты работы алгоритма не зависят от языка произнесенных человеком фраз, алгоритм возвращает численное значение эмоций мобильного устройства и человека, что является его несомненным преимуществом по отношению к известным алгоритмам.

Библиографическая ссылка

Михайлов В.О. АЛГОРИТМ ИЗМЕРЕНИЯ ЭМОЦИОНАЛЬНОГО СОСТОЯНИЯ АБОНЕНТА МОБИЛЬНОГО ТЕЛЕФОНА // Международный журнал экспериментального образования. 2013. № 10-2. С. 376-379;URL: https://expeducation.ru/ru/article/view?id=4252 (дата обращения: 24.04.2026).